2025年,我们用短短几个月的时间,完成了对主站黄流订单模块的重构升级。面对该模块长达12年的历史沉淀与逾30万行的代码规模,我们不仅实现了线上的平滑无缝切换,更成功落地了“一码三端”的研发模式。此次重构大幅缩短了功能上线与推广周期,并在关键交易链路上验证了研发效能3倍提升的可行性。

本系列文章将系统性地梳理我们在技术选型、专项攻坚、业务协同、引擎能力建设、公共能力沉淀、性能优化及端侧高可用建设等方面的实践经验与深度思考,旨在为集团各移动端团队的跨端动态化建设提供有益参考。

作为系列开篇,本文将重点复盘京东App黄流订单模块在跨端动态化演进过程中的技术选型决策路径、总体架构设计及关键技术落地方案。关于其他维度的深入探讨,欢迎查阅本系列的其他文章。。

1. 背景

随着移动互联网零售行业步入存量竞争阶段,行业逻辑已从早期的野蛮生长和粗放式扩张,全面转向精细化运营时代。在这一阶段,研发团队面临着层出不穷的交易模式创新、营销玩法迭代及视觉交互升级。核心竞争力的定义随之改变:谁能以更低的成本、更高效的速度完成线上实验与效果验证,谁就能在激烈的红海竞争中抢占市场先机。

业务痛点:需求吞吐与研发成本

黄流(主交易流程)作为全站业务的流量聚合枢纽,绝大部分新业务形态均需接入其中。这意味着,公司各BG/BU下数百个采销与运营团队的需求汇聚于此。面对海量且高并发的业务需求,传统的原生开发模式下,“一个功能、三端开发”的成本劣势被无限放大,导致需求积压严重,研发资源捉襟见肘,效能瓶颈日益凸显。

稳定性挑战:容错与止损

另一方面,黄流作为京东零售App交易链路的“大动脉”,承载着巨大的订单成交量。任何细微的端侧缺陷都可能被流量迅速放大,演变为严重的线上事故。因此,具备极速止损与故障恢复能力,是黄流端侧技术体系建设不可逾越的底线。

技术解法:一码多端与动态化

基于上述挑战,“一码多端”与“动态化”技术的结合应用,成为破局的关键:

- 一码多端:通过一套代码复用,实现Android、iOS及鸿蒙等平台的同步构建与发布。相比原生开发,该模式在不增加人力投入的前提下,大幅提升了需求吞吐量,实现了研发人效的倍增。。

- 动态化技术:通过产物的动态下发与运行时实时加载,实现了App功能的“热更新”。该技术绕过了传统应用市场的繁琐审核流程及用户手动更新的滞后性,将新功能的高覆盖率达成周期从传统的3周左右大幅压缩至“天级”,显著提升了业务响应速度与线上止损能力。

2. 目标

黄流的动态化建设最终选定“订单模块”作为首个攻坚阵地。整个试点项目制定了极具挑战性的“3+3”推进计划:

- 首期 3 个月:完成对沉淀 10 余年、代码量超 30 万行的“订单列表页”的跨端动态化全量重构,并完成线上灰度与技术验证;

- 二期 3 个月:在验证通过后,将订单模块内近 20 个页面全部完成改造,并实现 100% 切流至跨端方案。

黄流的动态化试点最终选择在订单模块先行试点,整个试点团队需要用3个月的时间,将已经沉淀了十多年,积累了30w+行代码的订单列表页,使用跨端动态化技术全部复刻一遍,并完成技术的线上验证;并需要在验证通过后3个月内实现订单模块全部近20个页面改造并全部切到跨端方案上。

尽管“一码多端”与“动态化”在研发效能上的收益显而易见,但在立项之初,我们仍需审慎地回答三个关乎技术路线可行性的灵魂拷问:

Q1. 性能与原生的差距客观存在,为何仍坚持跨端动态化路线?

这是一个关于 ROI的权衡。

必须承认,跨端技术因增加了逻辑引擎、渲染管线及差异化抹平层,动态化技术因涉及产物的下载与加载,理论性能上限确实难以完全追齐原生开发。

然而,在性能、开发成本、用户触达效率这“三元悖论”中,我们必须根据业务阶段做出取舍:

- 开发成本:面对海量的业务需求,成本的降低是黄流可持续发展的核心诉求;

- 触达效率:缩短发版周期是构建端侧高可用能力、实现快速止损的最大痛点;

- 长期趋势:随着移动设备硬件性能的持续提升及跨端技术的不断迭代优化,性能鸿沟将逐步缩小,这符合长期的技术演进趋势。

因此,我们的判断是:只要能将性能损耗控制在用户体验可接受的阈值内,跨端动态化就是当前阶段黄流研发团队的最优解。

Q2. 黄流链路复杂,为何选择“硬骨头”订单模块作为首个试点?

这一选择基于风险控制与技术验证的双重考量:

- 风险可控:在黄流全链路中,进入订单模块时用户通常已完成下单操作,相较于交易前的导购环节,此处发生小概率异常被放大的风险相对较小。

- 场景覆盖全:订单模块业务复杂度极高,涵盖了长列表、推荐位嵌套、复杂弹层、地图/视频组件等多种交互形态。拿下订单模块,意味着基本覆盖了黄流所有的技术场景,其试点结果对后续其他模块具有极高的参考价值。

Q3. 为何设定如此激进的时间表(3个月重构+3个月推全)?

这不仅是“高速换轮胎”,更是一次“高速换发动机”。设定高目标的原因在于:

- 链路依赖:订单模块是黄流动态化的桥头堡,其他页面的改造方案强依赖于此试点的成败。若进度滞后,将导致整个黄流的动态化进程受阻。

- 避免“双倍维护”的阵痛:在改造期间,原生的业务需求仍在高速迭代。战线拉得越长,意味着我们需要花费更多精力在跨端代码中追齐原生版本的新增需求。对于本就资源紧张的研发与测试团队而言,“长痛不如短痛”。

- 团队炼金石:短时间、高难度的突击战是检验团队战斗力的最佳方式。我们希望通过这一高目标,全方位打磨团队的技术架构设计能力、执行力、跨团队协作机制以及高可用保障体系(如“三板斧”机制的落地),激发团队在压力下的创新与突破能力。

3. 方案选型

在7月初技术方案选型时,公司内主要的跨端技术栈有 TN、Taro、玄机三种,这三种方案都还在发展中,在当时几乎都未真正达到相对成熟稳定的时期,因此当时方案的选型要点主要聚焦在应该渐进式修改还是全页面修改上。对试点而言,采用全页面的Taro方案,能够降低原生对试点结果的干扰,也能借助其成熟的生态提升开发效率,且未来还有相对清晰的路径实现更大范围的一码多端应用。

| 跨端技术栈 | 选型页面 | 技术优劣势(各跨端技术都在持续迭代中,请以各技术栈最新能力为准) |

| TN | 核心场域 (首页、搜推、消息、我京) | 优势:·分块改造,适合存量业务渐进式迁移不足: ·渐进改造过程中仍会有无法动态化的原生逻辑,需通过页面级容器(建设中)来补足 |

| Taro | 黄流订单+二三级页面 (订单列表、订单详情、换购页、凑单页、退款页等) | 优势:·全页面改造,UI 和逻辑全闭环在前端,最大程度减少对端侧依赖不足: ·引擎需要预热,不适合首页、商详这种对性能要求极高的场景 |

| 玄机 | 内容 (短视频、直播、评价问答、XR、点评、圈子等) | 优点:·分块改造,页面所有区块共享轻量JS运行时不足: ·不适合APP首页这种对首屏加载速度要求极高的场景(要配合预热,首页没时机) ·当前不支持鸿蒙端 |

4. 核心问题与解法:

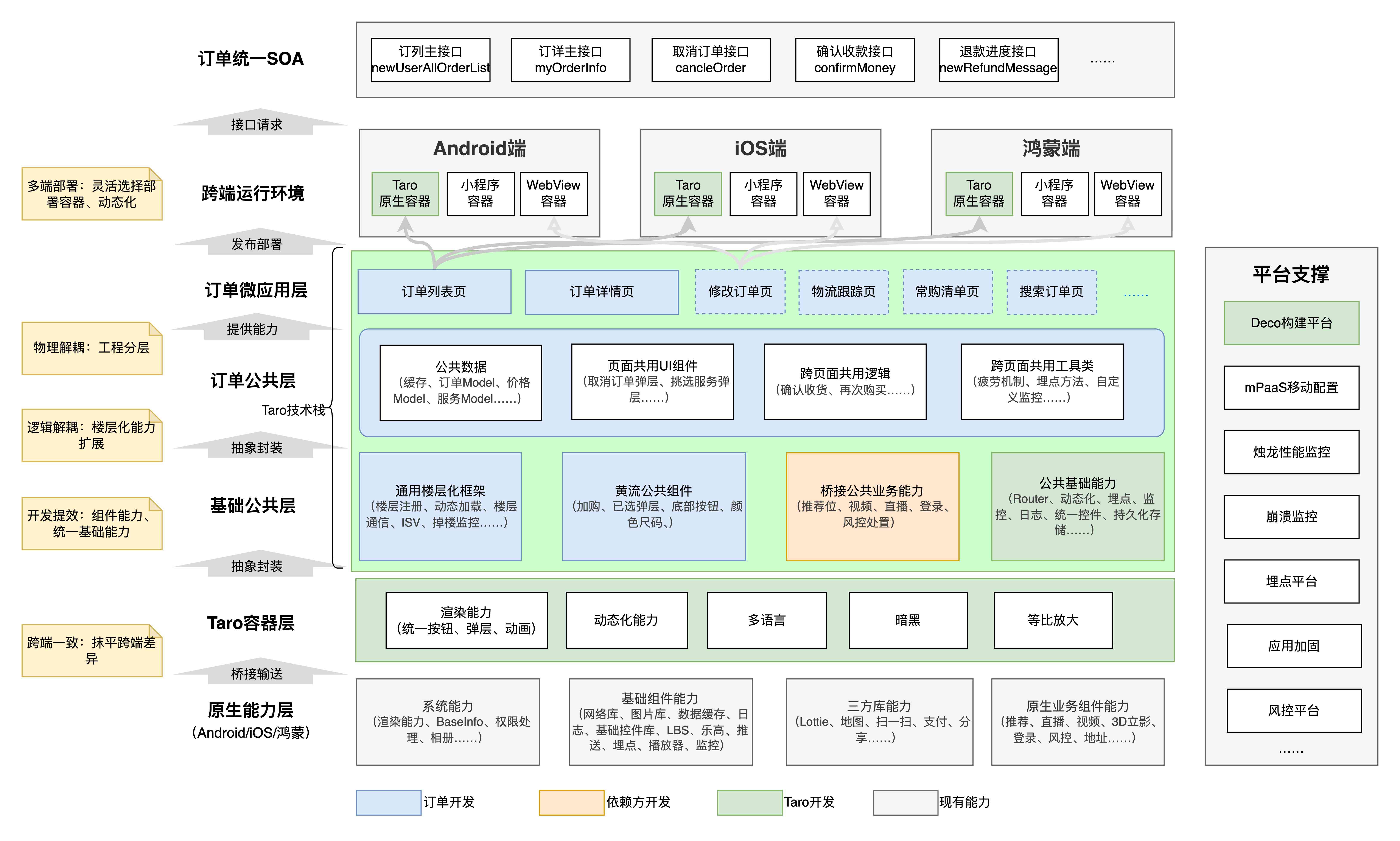

整体架构:统一SOA+Taro跨端技术实现Android、iOS、Harmony三端能力对齐

核心问题1:多人并行开发模式下如何互相不踩脚?

订单原生团队单端2人,试点团队开发12人,大家在同一个页面开发,怎么避免冲突

- 代码物理解耦:通过工程分层,实现页面、业务公共能力、基础公共能力的分层,以及未来的可演进

- 逻辑解耦:升级原生楼层化能力,可将全页面进行分块

- 部署解耦:页面独立发布,互不依赖

| 解决方向 | 关键词 |

| 工程架构 | 工程结构分层、代码隔离·apps:面向独立部署产物 ·packages:面向模块内复用能力(业务模型、公共逻辑等) ·submodules:面向跨模块复用组件(端到端组件、通用框架、公共桥接能力等) |

| 页面组件化 | 楼层解耦、全页面元素表达·楼层+弹层+弹窗+浮层+顶部导航+底部条+可扩展页面组件表达 |

| 发布部署 | 页面独立部署Android/iOS vs Taro跨端: ·Android/iOS:整体模块发布 ·Taro跨端:模块内单页面发布 |

核心问题2:如何加速开发效率?

绝大多数研发不了解订单业务、甚至Taro开发经验不足,如何能够快速上手

- 编码效率:组件复用、沉淀通用能力(hlfe组件、自动埋点、多模式适配等)

- 调试效率:JIT实时预览、组件源码调试等

- 发布效率:增加自动内置、自动更新

| 解决方向 | 关键词 |

| 编码效率-组件化 | 复杂业务组件复用、现有原生组件桥接 |

| 编码效率-楼层化 | 通用监控、通用楼层埋点、统一生命周期时机、公共能力(如楼层异步加载) |

| 编码效率-自动埋点 | 统一上报时机、收口上报位置 |

| 编码效率-模式适配 | 暗黑、字号放大、等比放大、国际化等 |

| 调试效率-工程架构 | 依赖组件源码调试 |

| 调试效率-Taro基建 | JIT实时预览 |

| 发布效率-动态化&ISV | 楼层&页面、多种生效策略、业务无侵入、无级联依赖发布 |

核心问题3:如何能够控制如此大改动的线上风险?

订单处于履约核心链路,一旦不可用极易出现严重事故,如何能在高速行驶中换发动机?

- 问题可观测:业务指标、稳定性指标、性能指标、客诉监控

| 监控方向 | 关键词 |

| 监控大盘 | ·业务、性能、引擎、下载、白屏 |

| 流量监控 | ·区分实验组、对照组的流量分布 |

| 业务指标监控 | ·对标产品口径的业务指标 |

| 崩溃 | ·区分实验组、对照组崩溃差异 |

| 客诉 | ·区分实验组、对照组客诉差异 |

| 容器异常 | ·Taro引擎异常监控 |

| 动态化下载 | ·Deco平台发布监控 |

| bundle加载监控 | ·动态化bundle生效监控 |

| 性能监控 | ·业务口径:诊断代码运行效率 |

| 业务异常 | ·对齐Android、iOS,实现 |

- 灰度&降级方案:切量方案、技术灰度方案、主动降级方案、被动降级方案

| 方案类型 | 关键词 |

| 切量方案 | ·考虑灰度时间 ·考虑版本计划 ·避开大促活动 ·避开节假日 |

| 技术灰度方案 | ·量级预估 ·iOS大流量灰度 |

| 降级方案 | ·主动降级 ·被动降级 ·熔断能力 |

过程总结:逢山修路,遇水搭桥,过程中推动众多基建能力补齐

与 SDK团队、基建团队、各工具平台团队 一起,创造了许多 第一次Taro SDK的 基础设施 完善- Taro鸿蒙端JIT调试工具

- 性能排查Lighthouse工具

- Deco自动化内置工具

- 统一资源下发工具

- Taro包资源分析工具

基础团队的 工具 完善- 鸿蒙端环境切换工具

- Taro自动埋点SDK

- 代码分布流水线工具

- 上线前代码错合、漏合分析流水线工具

平台团队的 功能/机制 完善- 烛龙平台的标准化Taro页面首开上报口径

- 试金石平台的全新订单性能指标

- 用户之声平台的按照版本、实验订阅客诉

- 发版团队的首个iOS大流量技术灰度方案落地

- 发版团队的TF用户激活功能,TF用户翻倍

5. 未来展望规划:

- 帮助黄流其他模块使用Taro一码三端提效(购物车、结算)

- 跨端页面试点转为H5兜底方案,实现一码四端甚至一码五端,实现原生代码的下线,助力包体积瘦身

- 在Taro中沉淀组件化方法论,与黄流产品一同抽象业务组件,标准化接需模式,提升接需效率础

鸣谢

感谢端技术、质量团队等团队的各位老板在过程中给予的充分指导,让整个项目始终按照正确的航向前行;

感谢整个项目组订单业务与Taro基础建设相关项目产研测同学的密切合作,互相的充分信任是项目大胆向前的有力保障;

感谢各位上下游同学、平台同学、版本同学的鼎力支持,顺利解决了上下游依赖、高可用诉求、灰度验证等关键难题。

订单一码多端系列文章

•方案选型与总体设计:主站黄流的3倍效率革命试点:京东App订单一码多端整体回顾

•业务重构经验篇:订单模块Taro一码三端业务改造经验分享:从多端困境到动态化转型之路

•工程架构篇:京东黄流"一码三端"重构:规模化协作下的工程架构实践

•Taro SDK开发能力与效率篇:Taro 5.0:跨端架构演进与业务规模化落地实践

•性能优化篇:黄流订单列表性能优化实践:一码三端下的业务层性能攻坚之路

•公共组件篇:开启一码五端,NutUI 组件库助力黄流跨端实现

•CI/CD篇:黄流订单列表页CI/CD实践:一码三端项目业务层提效之路

•高可用篇:黄流订单一码多端高可用建设拆解:高速上换发动机的安全保障

•AI提效篇:Cursor + GPT‑5‑Codex:从“匆匆忙忙”到“从从容容”的跨端提效与质量保障实践